Серверную плату нельзя выбирать только по сокету и цене: нужно проверять CPU, память, PCIe-линии, накопители, сеть, корпус, питание, охлаждение, удалённое управление и списки совместимости.

В статье разбираем, чем серверные материнские платы отличаются от обычных, какие функции действительно важны для виртуализации, СХД, баз данных, резервного копирования, GPU-вычислений и инфраструктурных сервисов, чем отличаются форм-факторы ATX, Micro-ATX, SSI-CEB, SSI-EEB и почему физическая совместимость не гарантирует стабильную работу сервера.

Для подбора оборудования используйте материнские платы, процессоры, оперативную память, SSD-накопители, сетевые карты, серверные решения и услуги ANDPRO.

Что разобрано в статье

Что такое серверная материнская плата

Серверная материнская плата — это основа вычислительного узла, на которой размещаются процессорные сокеты, слоты памяти, разъёмы питания, интерфейсы накопителей, PCIe-слоты, сетевые контроллеры, контроллер удалённого управления и датчики мониторинга.

В отличие от платы для обычного ПК, серверная плата проектируется под длительную нагрузку, работу 24/7, расширенные требования к памяти, стабильности, управлению, диагностике и обслуживанию. Она должна не просто запускаться, а предсказуемо работать в серверном корпусе, стойке, СХД или инфраструктурном узле.

Серверная плата определяет, сколько процессоров можно установить, какой объём памяти доступен, сколько будет линий PCIe, какие накопители и сетевые карты можно подключить, есть ли удалённая консоль, как управляются вентиляторы и какие компоненты входят в списки совместимости.

Чем серверная плата отличается от обычной

Главное отличие — ориентация на надёжность и управляемость. Серверные платы чаще поддерживают ECC-память, серверные процессоры Intel Xeon, AMD EPYC или workstation-платформы, большое количество PCIe-линий, удалённое управление BMC/IPMI и расширенный мониторинг.

Для корпоративных задач важны датчики температуры, напряжений и вентиляторов, журналы событий, удалённая консоль, управление питанием, поддержка RAID/HBA-контроллеров, сетевых адаптеров 10/25/40/100GbE и стабильная работа с большим объёмом памяти.

Обычная desktop-плата может подойти для домашнего NAS или тестового стенда, но для production-нагрузки, виртуализации, СХД и баз данных серверная плата даёт больше контроля, диагностики и совместимости.

ECC-память

Снижает риск ошибок памяти в виртуализации, базах данных, ZFS и СХД.

BMC/IPMI

Позволяет управлять сервером удалённо, даже если ОС не загружается.

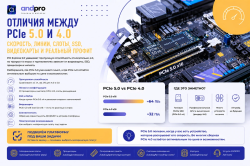

PCIe-линии

Нужны для GPU, HBA, RAID, быстрых сетевых карт и NVMe-накопителей.

Типы серверных плат по платформе и задаче

Односокетные серверные платы подходят для файловых серверов, небольших узлов виртуализации, резервного копирования, инфраструктурных сервисов, NAS и компактных решений. Они проще, экономичнее и часто достаточны для малого и среднего бизнеса.

Двухсокетные платы используют там, где нужны высокая плотность ядер, большой объём памяти, много PCIe-линий и масштабируемость: виртуализация, базы данных, вычисления, VDI, крупные инфраструктурные узлы и тяжёлые корпоративные сервисы.

Платы для GPU-серверов проектируются под ускорители: AI/ML, рендер, VDI, научные вычисления, inferencing и training-нагрузки. Здесь важны полноскоростные PCIe x16, расстояние между слотами, поддержка райзеров, питание GPU и airflow.

Платы для СХД и NAS должны хорошо работать с HBA-контроллерами, большим числом дисков, ECC-памятью, быстрыми сетевыми адаптерами, ZFS/Ceph/backup-нагрузкой и длительным I/O.

Сокет и процессор: что проверить

Сокет определяет физическую совместимость процессора, но не гарантирует запуск и стабильную работу. Нужно проверять список поддерживаемых CPU, версию BIOS/UEFI, stepping, TDP, количество каналов памяти, требования к питанию и ограничения конкретной ревизии платы.

У серверных платформ процессор влияет на число PCIe-линий, поддержку памяти, количество каналов, частоты, энергопотребление и тепловой режим. Поэтому выбор платы начинается не с форм-фактора, а с задачи и CPU-платформы.

Для виртуализации важны ядра, память и PCIe. Для базы данных — память, I/O и стабильность. Для СХД — HBA, сеть и ECC. Для GPU-сервера — PCIe x16, питание, airflow и совместимость ускорителей.

ECC-память: UDIMM, RDIMM, LRDIMM и QVL

ECC-память обнаруживает и исправляет отдельные ошибки в ячейках памяти. Для серверов это особенно важно: ошибка RAM может повлиять на виртуальную машину, базу данных, файловую систему, кэш, backup или расчётную задачу.

Серверные платформы могут использовать ECC UDIMM, RDIMM, LRDIMM и другие типы модулей. Они не взаимозаменяемы: нельзя выбирать память только по объёму, частоте и DDR-поколению. Нужно проверять тип модуля, ранги, организацию чипов, число модулей на канал и список совместимости.

QVL/HCL важны для серверов сильнее, чем для обычных ПК. Сервер может загрузиться с неподходящей памятью, но работать нестабильно под нагрузкой, выдавать ошибки ECC, снижать частоту или не проходить длительное тестирование.

Форм-факторы серверных материнских плат

Форм-фактор определяет размер платы, монтажные отверстия, совместимость с корпусом, направление airflow, доступность слотов расширения, расположение портов, питание, высоту радиаторов и удобство обслуживания.

ATX используют в башенных серверах, небольших серверных узлах и рабочих станциях. Micro-ATX и Mini-ITX подходят для компактных NAS, малых инфраструктурных серверов и edge-узлов, но ограничивают число слотов и накопителей.

SSI-CEB и SSI-EEB встречаются в серверных и workstation-платформах с большим числом слотов, памятью и иногда двумя процессорами. Такие платы требуют корпуса с правильной поддержкой стоек, питания, airflow и доступа к разъёмам.

Проприетарные платы используются в blade-серверах, плотных 1U/2U-платформах и системах конкретных производителей. Они хорошо интегрированы с шасси, но ограничивают замену компонентов и апгрейд.

ATX / Micro-ATX

Башенные серверы, NAS, малые узлы и компактные инфраструктурные системы.

SSI-CEB / SSI-EEB

Рабочие станции, двухсокетные серверы, GPU-системы и мощные платформы.

Проприетарные платы

Blade, 1U/2U и плотные серверы с жёсткой привязкой к шасси.

PCIe, накопители, HBA, RAID и GPU

Один из ключевых параметров серверной платы — количество и распределение PCIe-линий. От них зависит, можно ли одновременно установить GPU, HBA-контроллер, RAID-контроллер, сетевую карту 10/25/40/100GbE, NVMe-адаптеры и другие платы расширения без потери скорости.

Для СХД важны HBA-контроллеры, SAS/SATA/NVMe, U.2/U.3, SlimSAS, OCuLink, бэкплейн корпуса и совместимость с файловой системой. Для GPU-сервера важны полноскоростные PCIe x16, райзеры, расстояние между слотами, питание ускорителей и охлаждение.

Важно читать руководство к плате: некоторые слоты делят линии, часть M.2 может отключать SATA, а установка второго устройства может переводить слот из x16 в x8 или x4. Для сервера это критично, потому что нагрузка часто зависит от I/O.

BMC, IPMI и удалённое управление

BMC — это отдельный контроллер управления сервером. Он работает независимо от основной ОС и позволяет включать, выключать и перезагружать сервер, смотреть датчики, проверять журналы событий и подключаться к удалённой консоли.

IPMI, KVM over IP и web-интерфейс BMC особенно важны для серверов в стойке, ЦОД, офисной серверной или удалённой площадке. Без них многие операции требуют физического доступа: подключить монитор, клавиатуру, проверить POST, изменить BIOS или перезапустить зависшую систему.

Для production-инфраструктуры наличие BMC/IPMI почти всегда оправдано. Для домашнего тестового сервера можно обойтись без него, но обслуживание будет менее удобным.

Сеть и встроенные контроллеры

Серверная плата может иметь один или несколько сетевых портов: 1GbE, 2.5GbE, 10GbE или специальные интерфейсы для управления. Но встроенной сети не всегда достаточно: для СХД, виртуализации и высоконагруженных сервисов часто нужны отдельные PCIe-сетевые карты.

Для файловых серверов и backup важна пропускная способность сети. Для виртуализации — несколько портов, разделение трафика, VLAN, отказоустойчивость и совместимость гипервизора. Для СХД — 10/25/40/100GbE, RDMA или совместимость с выбранной архитектурой.

Сетевой контроллер нужно проверять не только по скорости, но и по поддержке драйверов в нужной ОС: Windows Server, Linux, VMware ESXi, Proxmox, TrueNAS, FreeBSD или другой платформе.

Питание, охлаждение и совместимость с корпусом

Серверная плата может требовать один или несколько EPS-разъёмов питания, дополнительные разъёмы для PCIe, вентиляторов, бэкплейна и служебных функций. При выборе нужно учитывать CPU, память, диски, GPU, сетевые карты, HBA и резерв по блоку питания.

Охлаждение серверной платы зависит от корпуса. В стойках 1U/2U часто используется направленный airflow с высокооборотистыми вентиляторами. В башенных корпусах airflow мягче, но нужно следить за VRM, памятью, PCIe-картами, HBA и SSD.

Даже если плата формально помещается в корпус, могут не совпасть стойки крепления, расположение питания, высота радиаторов, доступность портов, кабели SlimSAS/U.2, направление airflow или совместимость с бэкплейном.

Как выбрать серверную плату под задачу

Для виртуализации важны число ядер, объём ECC-памяти, PCIe-линии, сетевые адаптеры, несколько NVMe-накопителей и удалённое управление. Нужно заранее понимать число виртуальных машин, требования к памяти и дискам.

Для СХД или NAS важны HBA-контроллеры, ECC-память, стабильная работа с дисками, быстрые сетевые интерфейсы, совместимость с ZFS/Ceph/TrueNAS и возможность обслуживания накопителей.

Для базы данных критичны память, I/O, стабильное питание, быстрые накопители, сеть и предсказуемое поведение под длительной нагрузкой. Ошибка выбора платы может ограничить не CPU, а дисковую или сетевую подсистему.

Для GPU-сервера нужно проверять PCIe x16, расстояние между слотами, райзеры, питание ускорителей, airflow, совместимость шасси и поддержку конкретных GPU.

Виртуализация

CPU, ECC RAM, PCIe, сеть, NVMe и удалённое управление.

СХД / NAS

HBA, ECC, бэкплейн, сеть, диски, ZFS/Ceph и стабильный I/O.

GPU-сервер

PCIe x16, питание, райзеры, airflow и совместимость ускорителей.

Типичные ошибки при выборе серверной платы

Первая ошибка — покупать плату только по сокету. Процессор может физически подходить, но не поддерживаться BIOS, TDP, stepping, питанием или памятью.

Вторая ошибка — игнорировать QVL/HCL. Неподходящая память, HBA, сетевой адаптер или NVMe-накопитель могут запускаться, но работать нестабильно под нагрузкой.

Третья ошибка — недооценить PCIe-линии. Устройства могут быть установлены физически, но работать в урезанном режиме или отключать соседние слоты.

Четвёртая ошибка — не проверить корпус. Размер платы, стойки, airflow, бэкплейн, райзеры, питание и кабели должны быть совместимы как единая система.

Пятая ошибка — экономить на BMC/IPMI для удалённого сервера. Без удалённой консоли восстановление после сбоя может потребовать выезда к оборудованию.

Шестая ошибка — выбирать плату без привязки к задаче. Плата для NAS, GPU-сервера, базы данных и виртуализации может иметь разные приоритеты.

Чек-лист: как выбрать серверную материнскую плату

Определите задачу: виртуализация, СХД, NAS, база данных, GPU, backup, инфраструктурный сервер, файловое хранилище, edge-узел или рабочая станция.

Проверьте CPU-платформу: один или два процессора, сокет, поколение, TDP, BIOS, PCIe-линии, каналы памяти, требования к питанию и охлаждению.

Проверьте память: ECC, UDIMM/RDIMM/LRDIMM, максимальный объём, число каналов, ранги, частоты, правила заполнения и QVL производителя.

Проверьте PCIe и накопители: физические слоты, электрический режим x16/x8/x4, M.2, NVMe, SATA, U.2/U.3, SlimSAS, OCuLink, HBA, RAID и бэкплейн.

Проверьте сеть и управление: встроенные NIC, возможность установки 10/25/40/100GbE, BMC/IPMI, KVM over IP, датчики, журналы и драйверы под вашу ОС.

Проверьте корпус, питание и охлаждение: форм-фактор, стойки, airflow, EPS, вентиляторы, высоту радиаторов, кабели, райзеры и доступность обслуживания.

Совместимость

CPU, BIOS, память, HBA, NIC, GPU, накопители, шасси и прошивки.

Надёжность

ECC, BMC/IPMI, мониторинг, airflow и работа под длительной нагрузкой.

Масштабирование

PCIe-линии, память, сеть, накопители и запас под будущий апгрейд.

Частые вопросы

Можно ли использовать обычную материнскую плату вместо серверной?

Можно для домашнего сервера, тестового стенда или простой системы. Для виртуализации, СХД, баз данных и работы 24/7 лучше выбирать серверную плату с ECC, BMC/IPMI, проверенной совместимостью и нужными интерфейсами.

Всегда ли серверной плате нужна ECC-память?

Для ответственных задач — да. ECC особенно важна для виртуализации, баз данных, ZFS, СХД, файловых серверов и длительной работы под нагрузкой. Тип ECC-памяти зависит от платформы.

Что важнее при выборе: сокет или чипсет?

Важны оба параметра, но их недостаточно. Нужно проверять BIOS, TDP, память, PCIe-линии, корпус, питание, охлаждение и HCL/QVL для всей конфигурации.

Почему серверная плата может не подойти к корпусу того же размера?

Помимо размера важны монтажные отверстия, расположение EPS-разъёмов, airflow, высота радиаторов, доступность портов, кабели, райзеры и совместимость с бэкплейном.

Нужен ли IPMI/BMC для небольшого сервера?

Если сервер работает удалённо, в стойке или без постоянного физического доступа, BMC/IPMI сильно упрощает обслуживание. Для тестового узла он не всегда обязателен, но для production-инфраструктуры крайне желателен.

Можно ли через ANDPRO подобрать серверную плату под задачу?

Да. Специалисты ANDPRO помогут проверить совместимость процессора, памяти, корпуса, накопителей, HBA, сетевых карт, GPU, питания и подобрать серверную конфигурацию под вашу нагрузку.

Авторство и ответственность

Материал подготовлен для блога ANDPRO / ООО «АНД-Системс» как информационная статья о серверных материнских платах: функции, типы, форм-факторы, сокеты Intel Xeon и AMD EPYC, ECC UDIMM/RDIMM/LRDIMM, BMC, IPMI, KVM over IP, PCIe-линии, HBA, RAID, NVMe, U.2/U.3, SlimSAS, OCuLink, сетевые адаптеры, GPU-серверы, СХД, NAS, виртуализация, базы данных, питание, охлаждение и совместимость с корпусами. Статья помогает разобраться в принципах выбора, но не заменяет проверку спецификаций конкретной платы, шасси, CPU, памяти, контроллеров, накопителей, сетевых карт, GPU и документации производителя.

Для подбора серверной материнской платы, процессора, ECC-памяти, накопителей, HBA/RAID, сетевых карт, шасси, рабочей станции, сервера и подготовки КП обратитесь в ANDPRO: info@andpro.ru, +7 (495) 545-48-70.

Дата последнего обновления материала: 19 мая 2026 года.